文 | Shushu 環球零碳研究中心

最近關于AI聊天創作工具ChatGPT的討論很多。這是伊隆·馬斯克創建的OpenAI公司所研發。

先是微軟宣布再砸100億美金入股OpenAI,然后亞馬遜和美版“今日頭條”BuzzFeed宣布將在日常工作中啟用ChatGPT,同時,百度也宣布將于3月推出“中國版”的ChatGPT聊天機器人。在多家科技公司推波助瀾后,ChatGPT瞬間引發全球關注。

一些網友開始瘋狂測試ChatGPT,比如寫代碼、寫劇本、寫小說、寫新聞、寫作業、廣告文案、知識搜查,甚至玩游戲等,而ChatGPT展現的能力也不負眾望,不僅對答如流,甚至還充滿智慧,洞察人性,比真人回答都絲毫不差。

還有一些網友開始談論ChatGPT的投入成本,像谷歌、華為、特斯拉、微軟、Meta、蘋果等,每年投入數以百億美元的研發費用,被稱為燒錢無底洞。

但是,很少有人談論ChatGPT模型的環境成本。

我們要意識到,即使是數字產品也需要能源來開發和消耗。據統計,信息和通信技術 (ICT) 行業和數據中心行業在全球溫室氣體排放中所占比例相對較大,約占全球電力消耗的3-5%。

如果這些數字產品(從我們手機上運行的應用程序到在云端運行的數據),一旦所消耗的電力不是由可再生能源產生的,就會產生碳排放。這就是機器學習模型,也會產生碳排放的原因。ChatGPT也不例外。

谷歌曾表示,公司總能源消耗的15%用于研究、開發和生產中與機器學習相關的計算。據NVIDIA和亞馬遜估計,機器學習工作中推理處理占算力消耗的80%-90%。

這些模型所消耗的能源也影響著氣候變化。在本文中,我們將從碳足跡的角度來看一下ChatGPT對環境的影響。

這里我們可以采用廣泛使用的生命周期評估 (LCA)法,該法旨在涵蓋產品或過程生命周期的所有階段。

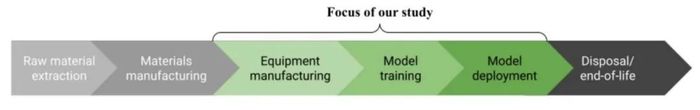

雖然生命周期評估 (LCA)法通常是評估產品從搖籃到墳墓的整個階段的碳排放,這將考慮到原材料提取的所有過程對環境的影響。但此次對于ChatGPT的評估是僅專注于從制造設備到模型部署運行,如下圖。

綠色部分為本次算ChatGPT生命周期碳足跡的3個主要階段,分別為設備制造,模型訓練,模型部署和運行。

那么,這3個主要階段中,ChatGPT的碳排放究竟是多少?

01 ChatGPT設備制造階段的隱形碳排放

首先,我們來看設備制造階段碳排放。

因目前關于ChatGPT的設備制造相關信息有限,我們以另一個大型語言模型BLOOM的設備制造碳排放作為類比,來推測ChatGPT該階段碳排放。

據了解,BLOOM和ChatGPT的前身GPT-3的模型大小大致相同,分別為176b和175b參數,因此設備方面也具有一定相似性。

設備制造階段的碳排放被稱為隱含碳。這是生產產品所涉及材料和過程相關的排放,例如訓練和部署模型所需的計算設備。雖然這些排放的產生僅限于制造過程,但這一總量通常分布在設備使用期間,方法是將這部分排放總量除以使用時間。

BLOOM模型在含有Nvidia A100 40GB GPU的HPE Apollo 6500 Gen10 Plus服務器上進行訓練。根據相關資料,與HPE Apollo類似的服務器生產碳足跡2500kgCO2e(二氧化碳當量)。這不包括服務器中使用的GPU的隱含碳排放,以論文[11]中估算,GPU的碳足跡約為150kgCO2e(二氧化碳當量)。

以IDRIS的數據,假設以6年的更換率和85%的平均使用率,用排放總量除以使用時間轉化為后,服務器每小時約0.056kgCO2e,GPU每小時約0.003kgCO2e。

根據[11]中表示,BLOOM訓練總時間共持續108萬小時,平均使用48個計算節點上的384個GPU,我們可以估計與模型訓練相關的服務器隱含碳排放大約為7.57噸和GPU3.64噸,總計約11.2噸。

以此類推,根據相關資料顯示,ChatGPT的訓練時間大約比BLOOM長3倍,單從這個角度估算,估算ChatGPT中模型訓練的隱含碳排放總量約為33.6噸。

不過這部分隱含碳還不包括其余計算基礎設施(如網絡交換機、冷卻設備和其他設備)的隱含排放。

02 ChatGPT模型訓練階段的碳排放

其次,估算模型訓練階段碳排放。

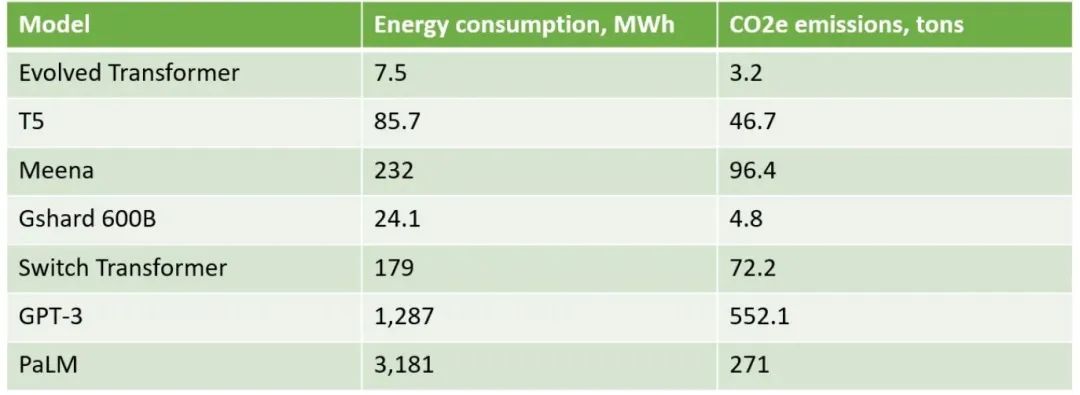

因為ChatGPT是基于GPT-3的一個升級版本,在GPT-3的模型架構基礎上進行了優化并在訓練時期增加了強化學習。以網上公開的數據表示,訓練一個GPT-3約消耗1287 MWh(兆瓦時)的電,相當于排放了552噸碳。

但由于強化學習需要額外消耗的電力,ChatGPT在模型訓練階段所產生的碳排放將大于552噸。

從這些大型語言模型的碳排放來看,ChatGPT前身GPT-3碳排放最大。據悉,美國人平均每年產生16.4噸碳排放,丹麥人平均每年產生11噸碳排放。因此,ChatGPT的模型訓練碳排放多于50個丹麥人每年的碳排放。

03 運行推理過程中ChatGPT的碳排放

再來估計運行推理階段碳排放。

假設繼續把BLOOM作為類比,可以推測ChatGPT運行階段的碳排放。

大型語言模型BLOOM曾在具有16個Nvidia A100 40GB GPU的Google Cloud Platform實例上部署并運行了18天,共432小時。

前面提到BLOOM與ChatGPT前身GPT-3的模型大小大致相同,因此我們假設把相同的硬件用于ChatGPT,并在16個Nvidia A100 40GB GPU上運行,并推測硬件利用率始終為100%。

由于ChatGPT公司OpenAI的總部位于美國舊金山,所以猜測ChatGPT的托管在美國西部。

使用ML CO2 Impact計算器,我們可以估算ChatGPT的每日碳排放為25.92 kg,如下:

實際上16個A100 GPU的計算能力并不能滿足真實的需求,如果假設ChatGPT每天有100萬用戶咨詢,每個用戶有10個問題,每個問題有30個單詞,ChatGPT的每個響應詞在A100 GPU上需要350毫秒,以此來計算:

100萬用戶*10個問題=10,000,000個響應=每天300,000,000個單詞*每個單詞0.35秒/每小時3,600秒=每天29,167小時的A100 GPU時間

根據Cloud Carbon Footprint列出ChatGPT的Azure數據中心中A100的最低功耗46W(瓦特)和最高 407W(瓦特)。為了方便計算,假設ChatGPT處理器都處于工作狀態,因此取該范圍的頂端消耗值。

每天29,167小時* 407W = 11,870kWh(千瓦時)

根據Cloud Carbon Footprint,美國西部的排放因子為0.000322167噸/千瓦時,所以ChatGPT運行階段的碳排放是:

0.000322167 * 11,870 = 每天3.82噸

04 ChatGPT的總生命周期碳足跡

根據以上計算,我們最后合算總生命周期碳足跡。

自ChatGPT于2022年11月30日上線以來,運行約60天,我們可以非常簡單粗略得到:

CHATGPT制造設備碳排放>33.41噸

CHATGPT模型訓練碳排放>552噸

CHATGPT運行60天碳排放≈3.82噸*60天≈229.2噸

三者相加后,CHATGPT自上線以來的生命周期碳足跡將大于814.61噸CO2e。

這個數值估計是基于一些粗略的假設,因此帶有很多不確定性,但與BLOOM等的可比較語言模型的碳足跡的全面估計相比,也存在一定合理性。

不過,本文僅關注ChatGPT的CO2e排放量。除了CO2e排放外,其他類型的環境影響,包括用水、空氣污染、土壤污染等,也需要重點考慮。

最后,通過這個初步計算,希望能啟發機器學習模型的開發人員披露他們模型準確的能耗或碳足跡。只有真正了解到這些信息,才能在我們討論如何減少我們的足跡時,優先解決那些產生最大碳減排的問題,同時評估模型的性能。

參考資料:

[1]https://arxiv.org/ftp/arxiv/papers/2204/2204.05149.pdf

[2]https://openai.com/blog/chatgpt/

[3]https://arxiv.org/pdf/2211.02001.pdf

[4]https://news.microsoft.com/2019/07/22/openai-forms-exclusive-computing-partnership-with-microsoft-to-build-new-azure-ai-supercomputing-technologies/

[5]https://arxiv.org/pdf/2111.00364.pdf

[6]https://kefm.dk/aktuelt/nyheder/2021/apr/foerste-officielle-vurdering-af-danmarks-globale-klimaaftryk

[7]https://storymaps.arcgis.com/stories/5417cd9148c248c0985a5b6d028b0277

[8]https://medium.com/towards-data-science/how-to-estimate-and-reduce-the-carbon-footprint-of-machine-learning-models-49f24510880

[9]https://towardsdatascience.com/the-carbon-footprint-of-chatgpt-66932314627d

[10]https://mlco2.github.io/impact/#publish

[11]ESTIMATING THE CARBON FOOTPRINT OF BLOOM, A 176B PARAMETER LANGUAGE MODEL

[12]https://towardsdatascience.com/how-to-estimate-and-reduce-the-carbon-footprint-of-machine-learning-models-49f24510880